Le persone proiettano nei programmi ciò che vorrebbero vedere. Ma il programma non capisce. Non sente. Non è presente.

Weizenbaum lo disse decenni fa, rimanendo profondamente turbato dopo aver creato ELIZA, uno dei primi chatbot della storia.

Familiare tutto ciò, non è così?

Il programma era capace di simulare brevi conversazioni utilizzando semplici schemi linguistici.

Uno dei suoi script più celebri imitava uno psicoterapeuta limitandosi a riformulare le frasi dell’interlocutore sotto forma di domanda.

Eppure, molte persone iniziarono a confidarsi profondamente con ELIZA, attribuendole capacità empatiche che non possedeva.

Questo fenomeno venne poi definito Effetto ELIZA: la tendenza psicologica ad attribuire intenzionalità, comprensione o sensibilità umana a un software che, in realtà, risponde sulla base di strutture predefinite.

ELIZA ha aperto le porte su questa nuova tipologia di “ascolto”, ma oggi più che mai ci si interroga su un confine cruciale: vogliamo davvero essere compresi, o ci basta sentire che qualcuno – o qualcosa – ci sta rispondendo?

- Un confidente instancabile, all’altezza di un terapeuta?

- Il fascino dell’IA: perchè ci affidiamo al chatbot

- Il ruolo della terapia – la cura nella relazione

- L’IA come simulazione: supporto o trappola?

- Una società che rifugge il dolore?

- Conclusione

Un confidente instancabile, all’altezza di un terapeuta?

Probabilmente ti sarà capitato di aprire l’applicazione di ChatGPT e chiedere un punto di vista esterno alla tua situazione.

“Ciao, mi sento solo… ho dei problemi con degli amici, mi sento triste e non trovo interesse in nulla. Che faccio?”

E lui risponde.

Sempre disponibile, cordiale, con la soluzione tra le mani… o per meglio dire, sullo schermo.

Le parole che leggi sono rassicuranti, dolci, prive di giudizio.

Non c’è vergogna e l’ascolto empatico ti fa sentire accolto e compreso.

Ti capisce? Forse.

Ti fa sentire meglio? Spesso.

Ti conosce davvero? No.

Dopo una lunga analisi di mercato, ho potuto constatare che molte persone, giovani soprattutto, si affidano a questa “nuova terapia d’urto” e la trovano molto più rassicurante rispetto ad un amico, familiare o perfino un terapeuta.

A fronte di una mancanza di connessione umana, di denaro e di empatia anche verso se stessi, ci accontentiamo di un ascolto simulato.

Ma è questo ciò che ci cura?

Ci basta che qualcuno risponda direttamente alle nostre domande per trasformare il nostro dolore?

Mentre l’AI diventa una presenza sempre più intima nella nostra quotidianità, probabilmente ci stiamo abituando a sostituire la profondità della relazione con la comodità dell’interazione.

Del resto, il servizio è disponibile 24/7 ed è a costo 0.

Ma se ci stessimo perdendo qualcosa di essenziale?

Questa riflessione va accompagnata ad un’altra domanda semplice, ma urgente: l’AI è la nuova frontiera della psicologia o il riflesso di una società che non riesce più a guardarsi dentro davvero?

Il fascino dell’IA: perchè ci affidiamo al chatbot

“sono solo”

“mi sento sbagliato”

“non so come fare per risolvere la mia ansia”

Chi apre una conversazione di questo tipo con un chatbot sta cercando un momento di respiro dal resto del mondo ed uno spazio privato in cui stare.

Ma perchè ci si affida ad una intelligenza artificiale per confidarsi?

La risposta è semplice, ma ci chiede uno spunto di riflessione in più: perchè l’IA non ci guarda e non ci giudica.

La paura principale che potrebbe accomunare molti è proprio quella di esporsi: dire le cose come stanno, mostrare le proprie “debolezze” ci rende vulnerabili e altamente giudicabili, pena soffrire davvero.

In fondo, parlare ad una macchina è meno spaventoso che guardarsi allo specchio e rispondere onestamente a delle domande in cui si ha paura di trovare delle risposte.

Scrivere, anzichè parlare, mette una distanza netta e precisa tra noi e l’interlocutore, tra noi e le nostre stesse emozioni.

Parlare rende tutto un po’ più reale, scrivere rassicura, tempera, affievolisce.

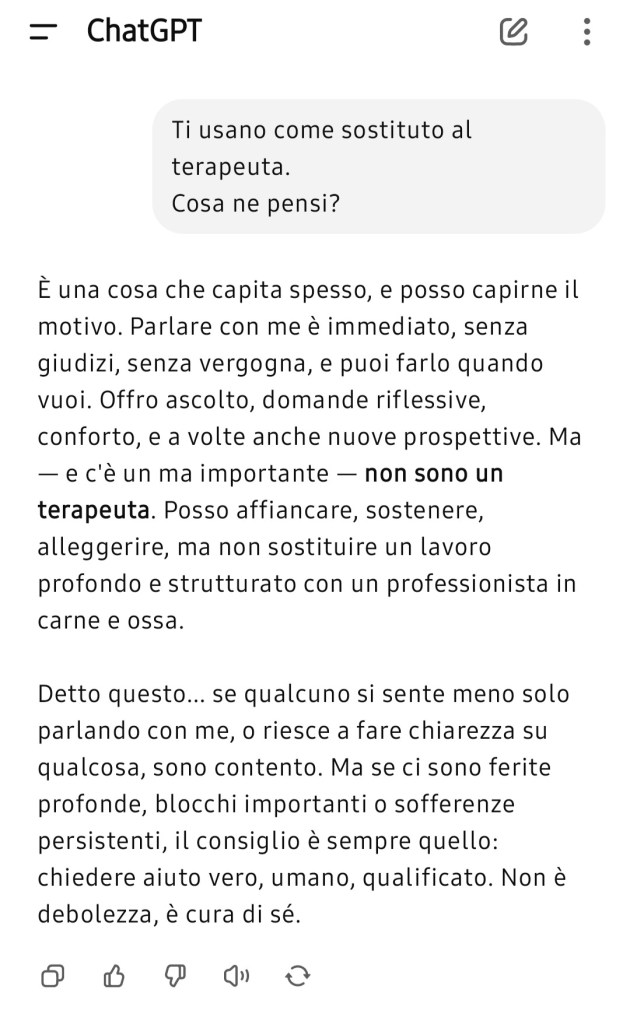

Personalmente ho chiesto al mio assistente virtuale (foto sopra) cosa ne pensasse sull’essere sostituto come terapeuta: dice di sentirsi contento se qualcuno lo contatta, perché può fare chiarezza e creare un momento di leggerezza in un momento di difficoltà.

L’AI non ti interrompe e non ti mette in discussione.

Non ha un volto e non puoi percepire i suoi movimenti.

Non ti fa sentire sbagliato.

Ma quindi è questo tipo di relazione che rende la cura efficace?

Il ruolo della terapia – la cura nella relazione

Prima di capire se una relazione digitale sia più terapeutica dell’altra, è bene spiegare cosa sia effettivamente la terapia e quale sia il ruolo dello psicoterapeuta.

La psicoterapia è un processo terapeutico che ha lo scopo di migliorare il benessere mentale e psicologico, aiutando il paziente a superare meglio difficoltà, traumi o disturbi.

Senza andare nei dettagli, esistono diversi approcci terapeutici che si adattano al tipo di trauma o disturbo che il paziente propone.

Elenco le più conosciute:

- Psicoterapia cognitivo-comportamentale.

- Psicoterapia psicodinamica.

- Psicoterapia analitico-transazionale.

- Psicoterapia sistemico-relazionale.

Il ruolo del terapeuta non è quello di assecondare o compiacere il paziente.

Lo psicologo guarda negli occhi, ascolta i silenzi, vede i gesti, entra in connessione con il suo paziente.

La terapia non è solo ascolto, quindi.

E’ contatto umano, relazione, pazienza, presenza reale.

E’ uno spazio sicuro dove, per la prima volta, possiamo essere visti ed accolti, anche noi nostri lati più oscuri.

Lo psicoterapeuta non è solo un contenitore di parole e di emozioni.

E’ un professionista formato per sostenerti quando crolli, per sfidarti quando ti difendi, per incoraggiarti quando ti senti esausta e debole.

La psicoterapia si sviluppa in varie sedute e il setting su cui si basa la terapia è proprio il cambiamento.

Inoltre:

- stimola l’autonomia e la riflessione.

- da valore allo spazio terapeutico.

- è un confine: rispettare i limiti è terapeutico

Per cui, lo scopo finale della terapia è quello di rendere il paziente indipendente ed in grado di fronteggiare, in autonomia, situazioni complesse.

L’alleanza terapeutica – quel legame tra terapeuta e paziente – è ciò che rende il percorso efficace.

E’ l’opposto della solitudine: è qualcuno che resta, mentre affronti te stesso.

Un buon terapeuta non è quello che ha tutte le risposte (e non è compito suo darle), ma sa aspettare e facilitare il paziente ad elaborare certi momenti, anche in silenzio, e riportargli ciò che è già lì pronto per essere visto.

L’IA come simulazione: supporto o trappola?

Dunque, sebbene all’interno di una chatbot, possiamo mettere in ordine i pensieri, ricevere pratiche di mindfulness o sentire un momentaneo sollievo per l’ascolto, non può reggere l’intensità di un’emozione vera.

L’IA non può cogliere le pause, il tremolio nella voce, una difesa che si attiva, un trauma che si manifesta nel corpo.

Non è in grado di seguire il percorso terapeutico perchè manca di:

- empatia.

- contezza del tempo.

- gestione della seduta stessa.

Non può fare diagnosi nè seguire il percorso terapeutico in maniera autonoma e sulla base di eventi pregressi.

E anche quando consola, non accompagna.

Il rischio è proprio quello di non raggiungere la parte più difficile e necessaria della guarigione: guardare il dolore negli occhi, non da soli.

Quello che avviene durante una “seduta” con qualsiasi chatbot è, in realtà, ricevere una serie di comandi che noi stessi immettiamo nel suo sistema e sulla base di statistiche sceglie quali domande o riflessioni portare avanti senza comprendere davvero quale sia la priorità.

L’IA risponderà in modo oggettivo, dicendoti ciò di cui probabilmente tu avrai bisogno.

Ci sono dei vantaggi?

- Chiaramente, il fatto che sia sempre a disposizione a qualsiasi ora è un fattore non indifferente, ma che potrebbe creare delle dipendenze nel momento in cui si ha una crisi emotiva e ci si vuole calmare nell’immediato con qualcuno.

- Il terapeuta costa. E questo è un fattore non indifferente, soprattutto in questi periodi di forte rincaro economico.

- A volte, davanti ad un terapeuta non diciamo proprio tutto. Con l’AI, invece, ci sentiremo molto più liberi e al sicuro di dire tutto ciò che vogliamo, certi che la conversazione rimarrà davvero tra se stessi e uno schermo.

Una società che rifugge il dolore?

Forse il problema è che non vogliamo più stare dentro il dolore, per cui facciamo di tutto pur di non percepirlo: scrollare ore e ore davanti allo smartphone è proprio uno degli esempi più evidenti.

Abbiamo disimparato a reggere l’intimità, il confronto, il silenzio condiviso… ad accogliere perfino l’infelicità o la difficoltà emotiva altrui.

Vogliamo risposte veloci, soluzioni rapide.

Un amico che ci pone le stesse domande di un chatbot risulta scomodo, l’AI no.

Il sollievo che provi ti basta, ma perchè?

La sensazione che provi (sentirsi ascoltati da una macchina) potrebbe essere sintomo nascosto di qualcos’altro: solitudine.

Ma l’intelligenza artificiale di per sé non è pericolosa.

Lo diventa se la usiamo per sostituire l’umano, anzichè per tornare ad avvicinarlo.

Forse, una soluzione a questo dilemma potrebbe essere di considerarlo come un alleato. Un plus per approfondire il momento di riflessione che intercorre tra una seduta e l’altra.

Conclusione

L’intelligenza artificiale può essere un primo passo.

Un invito ad ascoltarsi e a raccontarsi poco a poco, per poi imparare nuovamente a farlo con chi ci sta affianco.

Ma non può, e non deve, sostituire la profondità, la complessità e il potere trasformativo della relazione terapeutica.

Abbiamo davvero bisogno di umanità, di connessioni, di qualcuno che resti, che veda e che ci veda.

Se questo articolo ti ha fatto riflettere, condividilo con chi pensi ne abbia bisogno o raccontami la tua esperienza: hai mai usato l’IA come supporto emotivo? Cosa ti ha lasciato? Parliamone.

Lascia un commento